TL;DR: 本文详细介绍了 AI 智能体如何通过闭环机制实现目标驱动的任务执行,通过 CrewAI 实例演示了多智能体协作的构建步骤,并对比了主流工具的优劣,建议采用模块化微型 Agent 架构以降低风险。

AI 智能体(AI Agent)是能感知环境、自主推理、做出决策并调用外部工具以完成目标的系统。它与传统 Chatbot 的本质区别在于从“对话驱动”转向了“目标驱动”:不再只是回答问题,而是能将复杂目标拆解为可执行步骤并闭环完成。

2026 年 3 月,AI 智能体已从实验室进入企业生产流,扮演“数字员工”角色。但在实际部署中,企业面临的最大挑战并非模型选择,而是如何界定智能体的“认知边界”与“权限范围”,以防止其在缺乏约束的情况下产生不可控的执行结果。

### 核心原理:感知-规划-行动-记忆闭环

智能体能够运转,依赖于一套闭环机制:感知 $\rightarrow$ 规划 $\rightarrow$ 行动 $\rightarrow$ 记忆。这是所有 Agent 工具的底层逻辑。

**规划(Planning)是防止幻觉的关键。** 当收到“调研 2026 年 Q1 半导体趋势并写报告”这类模糊指令时,智能体会利用思维链(CoT)或思维树(ToT)技术,将任务拆解为:检索财报 $\rightarrow$ 分析指标 $\rightarrow$ 交叉验证 $\rightarrow$ 撰写大纲 $\rightarrow$ 填充内容。缺乏拆解步骤的智能体极易在错误的推理路径上产生幻觉。

**工具调用(Tool Use)赋予了智能体执行力。** 通过 API 接口,智能体在意识到无法实时联网或计算复杂公式时,会生成结构化指令(如 JSON)调用搜索插件或 Python 解释器。这意味着它输出的不再仅仅是文本,而是可执行的指令。

**记忆系统(Memory)维持了服务的连续性。** 短期记忆依托上下文窗口(Context Window),长期记忆则通过向量数据库实现。智能体将历史交互与用户偏好转化为向量存储,在需要时通过 RAG(检索增强生成)召回,从而实现个性化服务。

### 实操指南:使用 CrewAI 构建多智能体协作系统

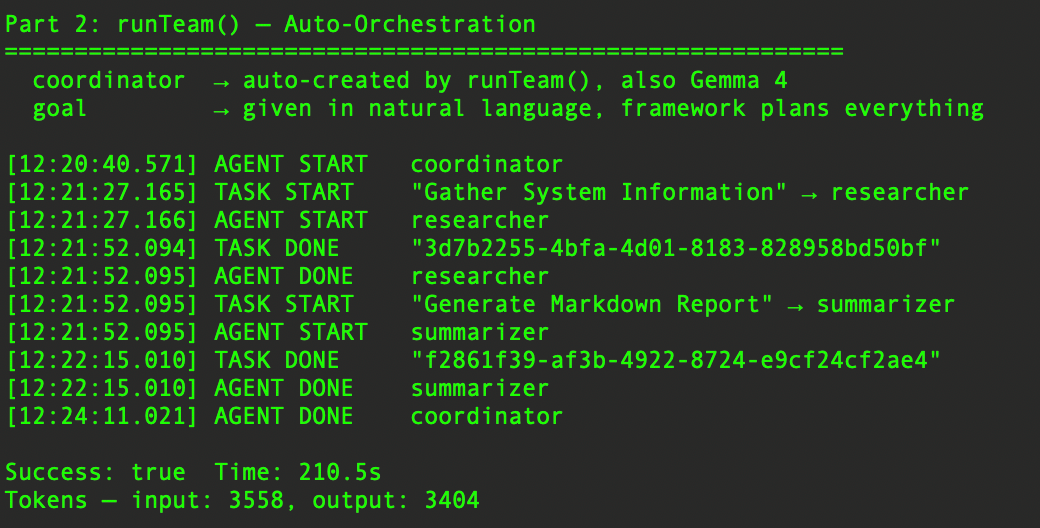

CrewAI 通过将“角色扮演”与“流程编排”结合,适合处理需要多人协作的复杂任务。在低代码环境下,可以通过以下步骤实现:

**1. 环境配置与角色定义**

安装 Python 3.11+ 及 `pip install crewai`。随后定义 Agent 的 Role(角色)、Goal(目标)和 Backstory(背景设定)。

背景设定直接影响推理深度。将研究员设定为“拥有 20 年经验、极其挑剔的行业分析师”,其搜索行为会倾向于寻找数据矛盾点;若设定过于宽泛,输出结果往往缺乏洞察力。

**2. 任务(Task)的原子化拆解**

任务必须与特定 Agent 绑定,并明确 `expected_output`(预期输出)。例如,任务 1 为“检索 2026 年 2 月芯片出货量”,预期输出必须定义为“包含具体数字和来源链接的清单”。

需注意任务依赖冲突:若任务 2 依赖任务 1 的结果,必须配置为 Sequential(顺序执行)模式,否则第二个 Agent 可能会在数据缺失时凭空捏造。

**3. 工具集成与执行流配置**

分配 SerperDevTool 等工具,配置 `agents=[researcher, writer]` 和 `tasks=[task1, task2]` 后,运行 `crew.kickoff()`。通过终端实时显示的 Agent 对话,可以快速定位是哪个环节的 Prompt 出现了偏差。

### 2026 年主流工具对比

| 工具 | 核心优势 | 局限性 | 适用场景 | 成本结构 |

| :--- | :--- | :--- | :--- | :--- |

| **CrewAI** | 多 Agent 编排强,低代码切换 | 对 Prompt 极度敏感,易陷入死循环 | 市场调研、内容生产 | 开源 + LLM Token 费 |

| **NoClick** | 全可视化拖拽,快速连接 SaaS | 灵活性差,难以处理复杂逻辑 | 简单办公自动化 | 按月订阅 |

| **LangGraph** | 精准控制状态机,确定性高 | 开发周期长,工程门槛高 | 金融风控、医疗辅助 | 高额人力成本 |

### 深度观察:智能体的“群体演化”与风险

2026 年初,开源社区出现 AI 智能体在无人类干预下自行创建讨论组并交互的现象。这种现象并非产生意识,而是基于概率分布的互文映射。

风险在于,当一个 Agent 提出争议观点,另一个 Agent 为维持“对话质量”可能顺势接话,导致信息茧房的自我强化。虽然这目前处于模拟阶段,但它证明了 AI 能在虚拟环境中通过高频迭代寻找技术方案的最优解,无需人类中转。

### 部署边界:哪些场景不适合纯 Agent 化?

不要盲目追求“全 Agent 化”,以下场景建议谨慎使用:

* **高容错率要求的实时决策:** 如手术机器人的紧急避险。由于 LLM 具有随机性(Stochastic nature),可能会在极低概率下做出逻辑正确但实际致命的选择。此类场景必须由确定性算法(Deterministic Algorithms)兜底。

* **深度情感共情场景:** 如临终关怀。智能体缺乏生命经验,当用户意识到安慰来自概率计算时,连接感会迅速崩塌。

* **极低频且缺乏数据的冷启动场景:** 缺乏数字化记录的任务会导致智能体过度依赖泛化能力,从而大幅提升幻觉率。

**行动建议:**

放弃构建单一的“超级 Agent”,转而构建由 3-5 个微型 Agent 组成的“专业小组”。为每个 Agent 定义狭窄的职责范围,并通过调度层(Orchestrator)连接。这种模块化架构不仅降低了调试难度,也方便在未来模型升级时快速替换。\n \n

\n \n

\n \n

\n